La sicurezza personale contro attacchi AI non è più una competenza riservata agli esperti IT, ma una consapevolezza strategica indispensabile per ogni utente. Nel panorama digitale contemporaneo, le minacce stanno evolvendo a un ritmo senza precedenti, guidate dall’accelerazione dell’intelligenza artificiale Per un utente privato, la comprensione di questa nuova frontiera non è più una questione di competenza tecnica avanzata, ma di consapevolezza strategica.

Le minacce moderne non si limitano più a vulnerabilità software o password deboli: affondano le loro radici nella capacità degli attaccanti di sfruttare l’AI per personalizzare e automatizzare l’ingegneria sociale, rendendo i tentativi di frode più sofisticati, convincenti e difficili da rilevare.

Due concetti emergono come pilastri di questa nuova era:

- Gli attacchi mirati basati su modelli AI

- Il fenomeno del data poisoning

Questi due elementi, spesso interconnessi, rappresentano una sfida fondamentale che richiede un cambiamento nel paradigma di sicurezza individuale, passando da una difesa puramente tecnica a una resilienza psicologica e comportamentale.

Sicurezza Personale contro Attacchi AI: i Principi Strategici da Conoscere

Un attacco mirato tramite modelli AI non è più una fantasia di fantascienza, ma una realtà documentata. Si tratta di campagne di ingegneria sociale altamente personalizzate, dove l’AI analizza le tracce lasciate online da un individuo – post sui social media, newsletter aperte, connessioni professionali – per comprendere il suo linguaggio, le sue relazioni, le sue paure e le sue aspirazioni. Il risultato è una comunicazione, sia essa un’email, un messaggio di testo o persino un video, che risuona con la psicologia della vittima in modo inquietante, aumentandone drasticamente la probabilità di successo.

Secondo le agenzie europee di cybersecurity, entro il 2025 le campagne di phishing supportate da IA rappresentavano già oltre l’80% di tutte le attività di ingegneria sociale osservate a livello globale.

Infografica con 4 tipologie: Insider Attacks, Backdoor Attacks, Data Injection

Il primo principio strategico da assimilare è che l’intelligenza artificiale, sebbene progettata per migliorare la nostra vita, è intrinsecamente un’“arma a doppio taglio”. Le stesse tecnologie che consentono assistenti vocali intelligenti, traduzioni rapide e personalizzazione dei servizi, possono essere ribaltate e utilizzate dagli aggressori per analizzare le nostre abitudini digitali, impersonare identità e diffondere disinformazione su scala industriale.

Il secondo concetto chiave è quello del data poisoning. Questo termine descrive un insieme di tecniche in cui un attaccante intenzionalmente compromette l’integrità dei dati su cui un modello di IA viene addestrato o alimentato. Non si tratta di hackerare direttamente il modello, ma di “contaminare” la sua memoria. Ciò può avvenire inserendo campioni di dati corrotti o fuorvianti nel dataset di addestramento, causando al modello di imparare associazioni errate o di sviluppare comportamenti specifici solo quando incontra un particolare pattern malevolo, noto come backdoor.

Una volta che il modello è stato “avvelenato”, diventa uno strumento potente e subdolo. Nella mente di un attaccante, il data poisoning è lo strumento ideale per preparare il terreno per un attacco mirato. Un aggressore potrebbe infondere in un modello pubblico di linguaggio informazioni false o manipolatorie tratte da fonti compromesse. Una volta che il modello ha internalizzato queste informazioni, può essere utilizzato per generare comunicazioni estremamente credibili che sembrano provenire da una persona nota, aprendo la porta a truffe finanziarie devastanti o inganni emotivi.

La vera natura della minaccia: sfruttare i punti deboli umani

Gli attacchi AI sono efficaci perché non colpiscono le porte di sicurezza dei sistemi, ma le falle cognitive del cervello umano. Un fenomeno studiato è la “macchina euristica”, ovvero la tendenza a considerare le macchine intrinsecamente più sicure e affidabili degli esseri umani. Quando un’informazione proviene da un’app di chat o da un motore di ricerca, l’utente tende a dare per scontata la sua veridicità, senza applicare il medesimo livello di scetticismo che riserverebbe a un amico o a una fonte non ufficiale.

Questo bias cognitivo viene ulteriormente amplificato dalla crescente antropomorfizzazione delle interfacce AI, con avatar conversazionali e toni di voce empatici che aumentano ulteriormente la fiducia dell’utente, anche quando non è giustificata. Questo porta a un secondo, e forse più pericoloso, effetto collaterale: la riduzione del pensiero critico.

L’uso massiccio di strumenti di IA generativa sta portando a una percezione di minore fatica cognitiva necessaria per ragionare, incoraggiando un’eccessiva dipendenza dallo strumento. La fiducia nell’AI tende a superare la propensione a verificare autonomamente le informazioni, creando un circolo vizioso: più ci si affida all’AI, meno si allenano le proprie capacità di analisi critica, rendendo l’utente ancora più suscettibile agli errori e alle manipolazioni.

Infografica sull’IA generativa come arma di attacco e strumento di difesa cybersecurity con phishing e deepfake

Pertanto, la strategia difensiva per l’utente privato deve spostarsi dall’installazione di firewall all’allenamento di un “sospetto intelligente”. Non si tratta di diffidare di ogni singola informazione online, ma di adottare un approccio metodico basato sulla verifica e sulla consapevolezza. La sicurezza personale nell’era AI non è un obiettivo statico, ma un processo dinamico di apprendimento continuo e adattamento comportamentale.

Riconoscere e Resistere agli Attacchi Mirati AI

Gli attacchi mirati basati sull’intelligenza artificiale rappresentano una delle minacce più pervasive e insidiose per gli utenti privati, poiché la loro efficacia deriva dalla capacità di simulare la realtà sociale e personale in modo sorprendentemente realistico. Questi attacchi non cercano di rompere sistemi informatici attraverso vulnerabilità tecniche, ma di ingannare l’utente attraverso l’ingegneria sociale avanzata.

1. Phishing e Spearphishing alimentato dall’IA

L’IA consente di automatizzare la creazione di messaggi di phishing altamente personalizzati, analizzando vasti quantitativi di dati pubblici per ricostruire il profilo di una vittima potenziale. Il risultato è un’email o un messaggio che parla di eventi specifici, usa un linguaggio coerente con le preferenze della persona e sembra provenire da una fonte legittima. La differenza cruciale rispetto al phishing tradizionale è la qualità e la pertinenza delle informazioni contenute, che rendono l’attacco molto più difficile da smascherare. Un utente medio non è più in grado di distinguere un’email genuina da una malevola basandosi su piccoli errori grammaticali o su un saluto generico.

2. Deepfake Audio e Clonazione Vocale

Grazie a modelli di IA avanzati, è oggi possibile replicare la voce di una persona con un grado di fedeltà tale da renderla indistinguibile dall’originale anche per un parente stretto. Questa tecnologia ha dato origine a nuove tipologie di truffe, come quella del “cloned familiar voice scam”, in cui un malintenzionato telefona a un familiare impersonando il parente e narrando una storia drammatica (es. un incidente, una rapina) per ottenere denaro urgentemente. L’impatto di tali attacchi va oltre la semplice perdita finanziaria: le vittime riportano gravi conseguenze sulla salute mentale, inclusi stress, ansia e depressione.

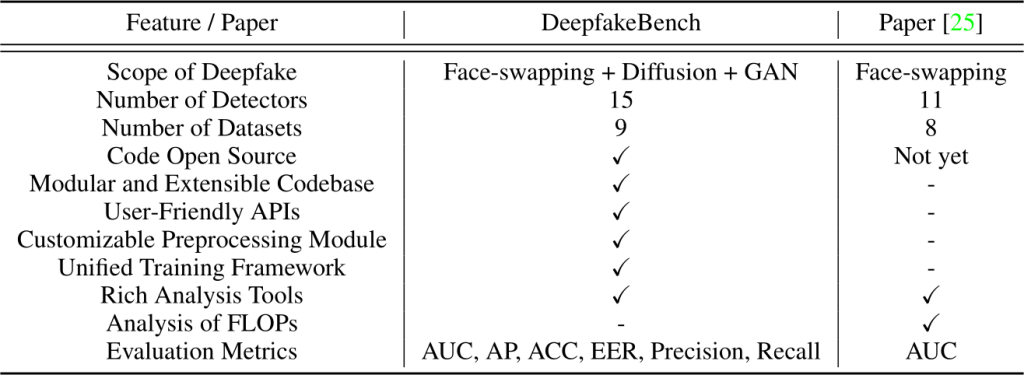

Tabella comparativa con feature, numero di detectors, datasets, metriche di valutazione (AUC, AP, ACC, EER)

Linee guida pratiche per riconoscere e contrastare i tentativi

| Caratteristica di Riconoscimento | Descrizione | Azione Consigliata |

|---|---|---|

| Urgenza e Pressione Emotiva | L’attacco cerca di creare panico o urgenza per impedire alla vittima di riflettere. | Non agire d’impulso. Controlla autonomamente la situazione tramite canali ufficiali alternativi. |

| Richiesta di Informazioni Sensibili o Azioni Finanziarie | La comunicazione chiede password, PIN, dati bancari o invoca bonifici/ricariche urgenti. | Ignora ed elimina. Nessun ente legittimo chiederà mai dati di accesso o pagamenti urgenti via messaggio. |

| Anomalie nel Canale di Comunicazione | La comunicazione arriva tramite un canale insolito o contiene link sospetti. | Verifica sempre. Non cliccare sui link. Accedi ai siti digitando manualmente l’URL nel browser. |

| Profili Social o Email con Piccoli Errori | Profili recenti, pochi contatti, foto rubate o indirizzi email con variazioni minime (es. @ciant.it invece di @banca.it). | Sospetta e incrocia le informazioni. Confronta dettagli, amici e attività con i contatti reali. |

| Contenuto Troppo Perfetto o Generico | Testo impeccabile ma privo di quel tocco personale o delle piccole imperfezioni umane. | Chiediti se la persona o l’azienda userebbe realmente un linguaggio così formale o complesso. |

Un altro fattore strategico è la consapevolezza delle etichette per contenuti generati dall’IA. Sebbene non universalmente applicate, alcune piattaforme stanno iniziando a contrassegnare i contenuti prodotti da sistemi artificiali. La presenza di queste etichette dovrebbe innescare automaticamente un livello superiore di attenzione. Infine, è fondamentale educare se stessi e i propri cari, specialmente gli anziani, a queste nuove forme di inganno. La resistenza non è un evento singolo, ma una pratica quotidiana di pensiero critico e verifica.

Contromisure Operative: Azioni Concrete per la Sicurezza Quotidiana

Se la comprensione strategica fornisce la mappa mentale per navigare le nuove acque digitali, le contromisure operative rappresentano gli strumenti e le abitudini concrete che ogni utente privato può implementare per ridurre significativamente il proprio rischio.

🛡️ 1. Gestione proattiva della privacy online

Poiché gli attacchi mirati AI si nutrono di informazioni personali, ridurne la disponibilità pubblica è una delle difese più efficaci.

- Revisione delle Impostazioni di Privacy: Limita la visibilità di post, luogo di lavoro, istruzione, nomi dei parenti e cronologia di residenza al cerchio di amici fidati o a “solo io”. Disattiva la geolocalizzazione nei post.

- Riduzione della Traccia Digitale: Esamina e rimuovi periodicamente vecchi post, foto e commenti rivelatori. Usa i motori di ricerca per verificare cosa emerge cercando il tuo nome.

- Criticità verso le Richieste di Informazioni: Chiediti sempre “Perché questo sito/app ha bisogno di sapere questo?” prima di inserire dati personali.

⚙️ 2. Configurazione sicura dei dispositivi e dei servizi

- Software Antivirus e Firewall Aggiornati: Mantieni sempre aggiornate le definizioni dei malware. Attiva i firewall nativi del sistema operativo e del router.

- Impostazioni per Microfoni e Telecamere: Disabilita l’accesso a microfoni e fotocamere per tutte le app che non ne hanno un uso dichiarato e indispensabile.

- Password Forti e Password Manager: Utilizza password uniche, lunghe e complesse per ogni account. Affidati a un gestore password affidabile per memorizzarle in sicurezza.

- Autenticazione a Due Fattori (2FA): Abilitala su tutti gli account importanti. La 2FA richiede un secondo fattore di verifica oltre alla password, rendendo molto più difficile l’accesso non autorizzato.

📱 3. Strumenti e protocolli aggiuntivi

Per le comunicazioni vocali, considera l’uso di applicazioni di messaggistica con crittografia end-to-end robusta e funzionalità di verifica. Nel caso di comunicazioni sensibili, stabilisci con i tuoi cari un protocollo di verifica predefinito (es. una frase segreta o un codice) da utilizzare se ricevi una richiesta insolita. La combinazione di queste misure crea un ambiente di sicurezza più ostico per gli aggressori.

Il Data Poisoning: Un’Insidia Silenziosa e le Sue Implicazioni

Il data poisoning rappresenta una minaccia particolarmente subdola perché agisce a un livello inferiore rispetto agli attacchi visibili, compromettendo l’integrità fondamentale dei sistemi di IA. A differenza di un virus o di un ransomware, il data poisoning può introdurre piccole, quasi impercettibili alterazioni nei dati di addestramento, con conseguenze che emergono solo in circostanze specifiche.

Diagramma che mostra il flusso completo: Training Data → Machine Learning Model → Attacchi (Poisoning, Extraction, Evasion)

Il data poisoning consiste nell’atto deliberato di introdurre dati contaminati o manipolati in un flusso di dati destinato a un modello. Gli obiettivi possono variare: creare una backdoor nascosta, degradare le prestazioni generali del modello, o diffondere deliberatamente contenuti errati o discriminatori. Studi hanno dimostrato che un numero sorprendentemente basso di campioni malevoli può essere sufficiente a compromettere un modello di linguaggio, dimostrando la facilità con cui questo tipo di attacco può essere perpetrato.

Cosa significa per l’utente privato?

Quando interagisci con un chatbot, un motore di ricerca o un’app di traduzione, ti affidi implicitamente alla qualità dei dati su cui questi sistemi sono stati addestrati. Un modello contaminato può portare a conclusioni errate, raccomandazioni pericolose o alla perpetuazione di stereotipi e disinformazione.

Sebbene le difese tecniche avanzate siano prerogative degli sviluppatori, l’utente privato può adottare comportamenti saggi:

- Non dare nulla per scontato: Se un modello produce una risposta troppo precisa, eccessivamente polemica o “strana”, potrebbe essere sintomo di un addestramento contaminato.

- Diversifica le fonti: Non dipendere da un singolo modello AI. Confrontare le risposte di diverse piattaforme (cross-checking) aiuta a identificare bias o errori.

- Segnala gli errori: Utilizza le funzionalità di feedback per segnalare contenuti offensivi o non veritiere. Contribuisci attivamente a migliorare la qualità dei sistemi.

- Scegli piattaforme trasparenti: Dove possibile, preferisci servizi che dichiarano di seguire standard di sicurezza e gestione del rischio AI riconosciuti a livello internazionale.

Costruire Resilienza Personale: Sviluppare un Approccio Critico all’Informazione AI-Generata

La protezione duratura contro le minacce emergenti dell’intelligenza artificiale trascende l’installazione di software o la configurazione di impostazioni. Risiede, in ultima analisi, nella costruzione di una resilienza personale fondata su un approccio critico e interrogativo verso ogni forma di informazione.

In un mondo dove la distinzione tra il reale e il sintetico diventa sempre più labile, le abilità cognitive diventano l’ultima e più importante linea di difesa. Questa resilienza non è un dono innato, ma un muscolo che deve essere allenato attraverso la consapevolezza, la curiosità e l’abitudine alla verifica. Il principio strategico fondamentale è: “Verifica sempre, anche se sembra troppo reale.”

3 Pilastri per Allenare il Pensiero Critico

- Verifica incrociata sistematica: Quando un modello genera una notizia, una citazione o una risposta tecnica, non fermarti alla prima risposta. Confronta con fonti tradizionali, enciclopedie, riviste o altri modelli AI. Impara a vedere le IA come strumenti potenti da interpretare, non come oracoli infallibili.

- Educazione continua: La tecnologia AI evolve rapidamente, e con essa anche le tecniche di attacco. Mantieniti informato attraverso fonti attendibili, report di agenzie di cybersecurity e articoli di esperti. La conoscenza è la migliore arma contro l’ignoranza.

- Gestione attiva dell’ecosistema digitale: Riduci la dipendenza dai filtri algoritmici che creano “bolle informative”. Esponiti a una pluralità di opinioni e fonti per sviluppare una visione del mondo più robusta. Riconosci e gestisci i tuoi bias cognitivi (come l’effetto alone o l’eccessiva fiducia nell’autorità tecnologica) per evitare che influenzino le tue decisioni.

Conclusione

La guida per l’utente privato non può essere un semplice elenco di istruzioni tecniche. Deve essere un programma di allenamento mentale. Significa passare da un ruolo di consumatore passivo di contenuti digitali a quello di un cittadino digitale attivo e critico.

La resilienza personale non si misura dalla robustezza del proprio firewall, ma dalla solidità del proprio pensiero critico. È la capacità di guardare un video realistico e chiedersi “Come è stato fatto?”, di leggere un’email apparentemente urgente e rispondere con calma, di ricevere una risposta da un chatbot e cercare una seconda opinione. Questo approccio, che combina cautela e curiosità, è l’unica vera difesa a lungo termine in un futuro dove l’IA sarà sempre più integrata nella nostra vita quotidiana e le linee tra il vero e il virtuale sempre più sfocate.

Fonti Istituzionali e Riferimenti Accademici

Questo articolo si basa su report, studi e framework pubblicati da agenzie internazionali di cybersecurity, enti di ricerca e riviste scientifiche peer-reviewed.

- 🇪🇺 Agenzie Europee e Framework Internazionali

- ENISA – European Union Agency for Cybersecurity

- NIST – National Institute of Standards and Technology (USA)

- Enti di Ricerca e Aziende Tecnologiche

- Microsoft Research

- IBM Security

- Cisco / Outshift

- Stanford HAI – Human-Centered AI Institute

- Riviste Scientifiche e Piattaforme Accademiche

- ACM Digital Library

- MDPI – Multidisciplinary Digital Publishing Institute

- ScienceDirect / Elsevier

- SpringerOpen

Nota metodologica: Tutti i link sono stati verificati e puntano a documenti pubblici o open-access(2024-2026).