Gli Stati Uniti hanno rilasciato 50 modelli AI notable nel 2025, la Cina 30, l'Europa appena 2 — mentre gli investimenti globali in AI hanno toccato i 581 miliardi di dollari, più del doppio del 2024. Lo Stanford AI Index 2026, pubblicato il 13 aprile dall'Institute for Human-Centered AI dell'Università di Stanford, fotografa in oltre 400 pagine una corsa che accelera su ogni asse misurabile — capacità di calcolo, investimenti, benchmark — mentre una frattura geopolitica diventa impossibile da ignorare.

Il rapporto annuale non racconta semplicemente la crescita dei modelli. Racconta uno scarto: tra i paesi che costruiscono l'infrastruttura AI e quelli che stanno ancora decidendo cosa farne, tra i benchmark conquistati e i compiti banali che i modelli sbagliano, tra l'entusiasmo degli investitori e il malcontento crescente delle comunità locali americane, dove alcuni governi municipali hanno iniziato a vietare la costruzione di nuovi data center.

Stanford AI Index 2026: calcolo triplicato, investimenti raddoppiati

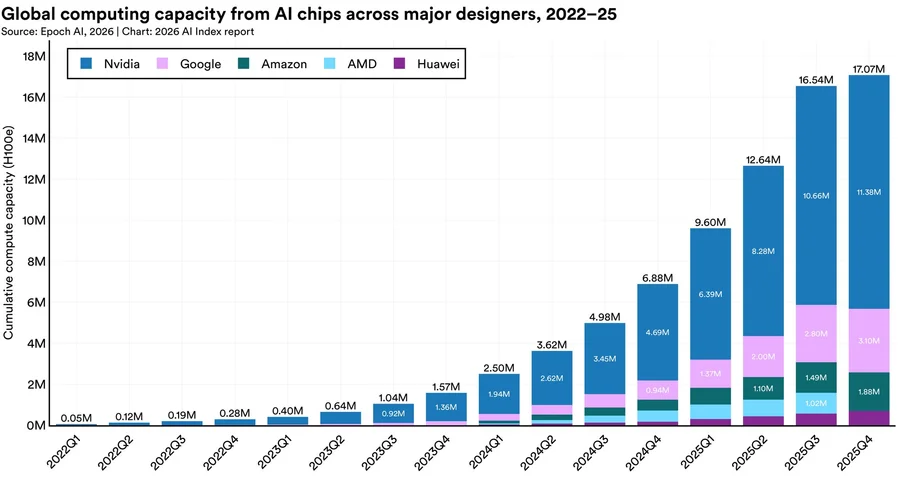

capacità di calcolo globale derivante dall'intelligenza artificiale dei principali progettisti, 2022-25, fonte: Epoch AI

La capacità globale di calcolo AI — misurata in H100-equivalenti di Nvidia come unità di riferimento — è triplicata ogni anno dal 2022, per un totale di 30 volte rispetto al 2021. Nvidia da sola copre oltre il 60% della capacità mondiale; Amazon e Google, che progettano chip proprietari per i propri workload, seguono a distanza. Sul fronte dell'hardware fisico la Cina consolida un primato diverso: 295.000 robot industriali installati nel 2024, circa otto volte gli Stati Uniti e sette volte il Giappone.

Gli investimenti sono il dato più vertiginoso. I 581 miliardi di dollari del 2025 superano il precedente record del 2021 (360 miliardi) e raddoppiano il 2024 (253 miliardi). Ma c'è una differenza strutturale rispetto a cinque anni fa: se nel 2021 il grosso veniva da fusioni e acquisizioni, nel 2025 il motore è il capitale privato diretto. Di quei 581 miliardi, 344 sono finiti negli Stati Uniti. Il contesto aggiunge un'altra variabile: OpenAI e Anthropic — le due aziende di modelli di frontiera più citate nel rapporto — si preparano entrambe alla quotazione in borsa entro la fine del 2026, un passaggio che trasformerà definitivamente l'AI da categoria venture capital a settore quotato.

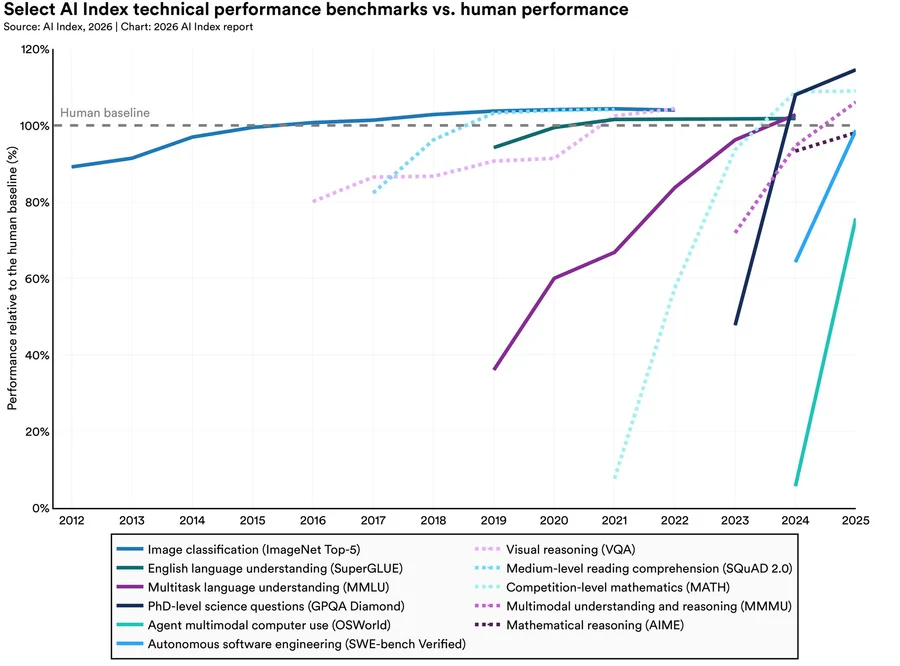

Sul piano delle capability, i benchmark cadono a ritmo sostenuto. Humanity's Last Exam — un test creato da esperti di settore per rappresentare i problemi più difficili nei rispettivi campi — è passato dall'8,8% di accuratezza del modello top nel 2025 (OpenAI o1) a oltre il 50% nei modelli disponibili ad aprile 2026, inclusi Claude Opus 4.6 di Anthropic e Gemini 3.1 Pro di Google. OSWorld e SWE-Bench Verified, i benchmark sull'uso autonomo del computer e sulla programmazione agentica, mostrano le curve più ripide dell'intero grafico Stanford.

Paragone tra i benchmark delle prestazioni tecniche dell'AI index e le prestazioni umane, AI Index, 2026

Legenda del benchmark:

- Image classification (ImageNet Top-5) → Classificazione di immagini English language understanding (SuperGLUE) → Comprensione della lingua inglese Multitask language understanding (MMLU) → Comprensione linguistica multitask PhD-level science questions (GPQA Diamond) → Domande scientifiche di livello dottorato Agent multimodal computer use (OSWorld) → Uso multimodale del computer da parte di agenti Autonomous software engineering (SWE-bench Verified) → Ingegneria del software autonoma Visual reasoning (VQA) → Ragionamento visivo Medium-level reading comprehension (SQuAD 2.0) → Comprensione del testo di livello medio Competition-level mathematics (MATH) → Matematica di livello competizione (olimpiadi) Multimodal understanding and reasoning (MMMU) → Comprensione e ragionamento multimodali Mathematical reasoning (AIME) → Ragionamento matematico

Le crepe dentro lo Stanford AI Index

Il rapporto è esplicito sui limiti delle proprie metriche. I benchmark vanno interpretati con cautela, avverte Ray Perrault, co-direttore del comitato direttivo dell'AI Index.

“In generale non disponiamo di misure su quanto bene un sistema, o un agente, debba funzionare in un contesto specifico. Sapere che un benchmark di ragionamento legale ha il 75% di accuratezza ci dice poco su come si comporterebbe nell'attività di uno studio legale.” — Ray Perrault, Stanford HAI, AI Index 2026

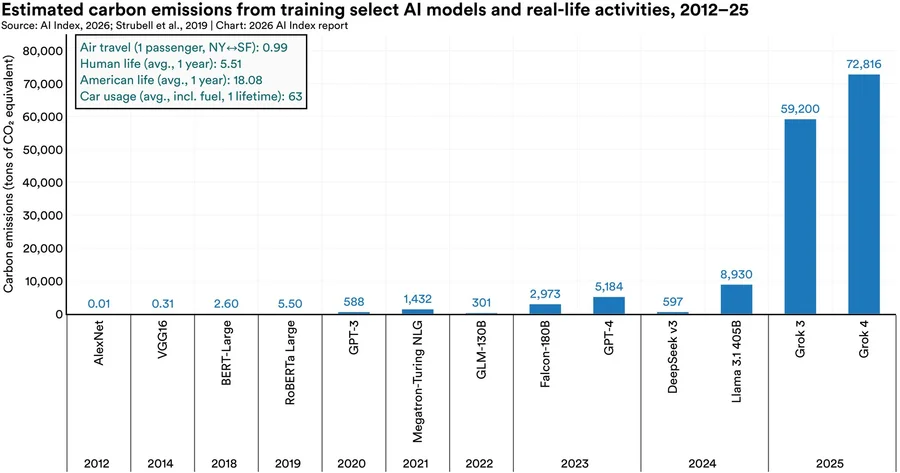

C'è poi la questione delle emissioni. L'AI Index stima che l'addestramento di Grok 4 di xAI abbia generato oltre 72.000 tonnellate di CO₂-equivalente — contro le 5.184 di GPT-4 nel 2023 e le 8.930 di Llama 3.1 405B di Meta. Ma la certezza è meno solida di quanto il numero suggerisca.

emissioni di carbonio stimate derivanti dall'addestramento di determinati modelli di IA e da attività reali, 2012-25, fonte: AI Index, 2026, Strubbell et al.

“Queste stime vanno interpretate con cautela. Nel caso di Grok si basano in larga parte su input inferiti da report pubblici, dichiarazioni di xAI e altre fonti non verificabili, introducendo un grado di incertezza. Epoch AI stima indipendentemente le emissioni di Grok 4 a circa 140.000 tonnellate di CO₂.” — Ray Perrault, AI Index 2026

Le emissioni dell'inferenza — cioè dell'uso quotidiano dei modelli, non del loro addestramento — mostrano una variabilità di oltre dieci volte tra modelli diversi. Il rapporto stima che DeepSeek V3 consumi circa 23 watt per rispondere a un prompt di lunghezza media, mentre Claude 4 Opus si ferma attorno ai 5 watt. Il dibattito sull'impatto energetico dell'AI, finora centrato sull'addestramento, si sposta verso una metrica più rilevante per il futuro: quanto pesa ogni singola conversazione moltiplicata per miliardi di richieste al giorno.

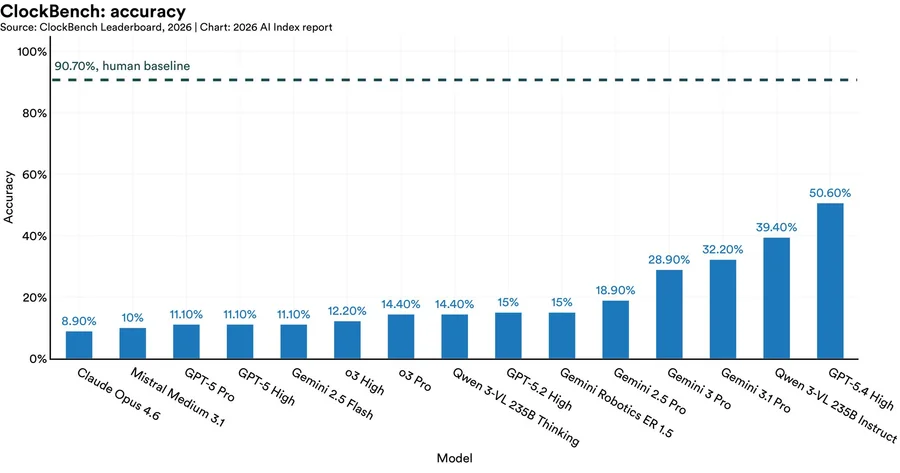

I limiti emergono anche sul piano delle capability operative. Claude Opus 4.6, che supera il 50% su Humanity's Last Exam, legge correttamente un orologio analogico solo nell'8,9% dei casi secondo il benchmark ClockBench. Il modello migliore, GPT-5.4 high di OpenAI, arriva al 50,6% contro un baseline umano del 90,7%. Sul fronte occupazionale il quadro è altrettanto ambiguo: le posizioni entry-level per sviluppatori software e operatori customer support sono in calo, ma quelle mid-career e senior sono stabili o in crescita, e il rapporto segnala che la disoccupazione tra i lavoratori meno esposti all'AI è cresciuta più che tra quelli più esposti.

Fonte: ClockBench, Classifica, 2026

C'è poi il paradosso americano. Gli Stati Uniti guidano su investimenti, infrastruttura e modelli rilasciati, ma solo il 31% dei cittadini si fida del proprio governo nella regolazione dell'AI — ultima posizione in una classifica Ipsos di 28 paesi, sotto perfino Giappone (32%) e Ungheria (33%). La domanda che nessun investitore di Silicon Valley si pone a voce alta è semplice: quanto può continuare ad accelerare un'industria in un paese dove i governi locali iniziano a vietare i data center e la fiducia nell'istituzione che dovrebbe regolarla è minoritaria?

Solo due modelli notable dall'Europa: cosa cambia per l'Italia

I 2 modelli europei del 2025 non sono un dettaglio statistico. Nel 2015, secondo la stessa serie storica di Epoch AI, l'Europa era sostanzialmente alla pari con gli Stati Uniti per numero di modelli notable rilasciati. In un decennio il divario è diventato incolmabile con le infrastrutture attuali. Per l'Italia e l'ecosistema AI europeo — che nell'iter dell'AI Act ha giocato un ruolo di mediazione tra il fronte pro-innovazione e quello pro-regolazione — il dato pone un problema strategico: il continente regola una tecnologia che non produce più.

La fiducia degli italiani nella capacità del governo di regolare l'AI è al 50%, esattamente sulla mediana globale e sopra la media europea occidentale (Francia 42%, Germania 49%, Regno Unito 39%). Non è una crisi di consenso, ma nemmeno un mandato forte. Il 59% dei rispondenti a livello globale ritiene ora che i benefici dell'AI superino i rischi, quattro punti in più rispetto al 2024, e il 68% dichiara di avere una “buona comprensione” della tecnologia. La finestra di consenso esiste e si sta lentamente allargando — i recuperi più forti anno su anno sono stati registrati proprio in Germania (+12 punti), Francia (+10) e Paesi Bassi (+10).

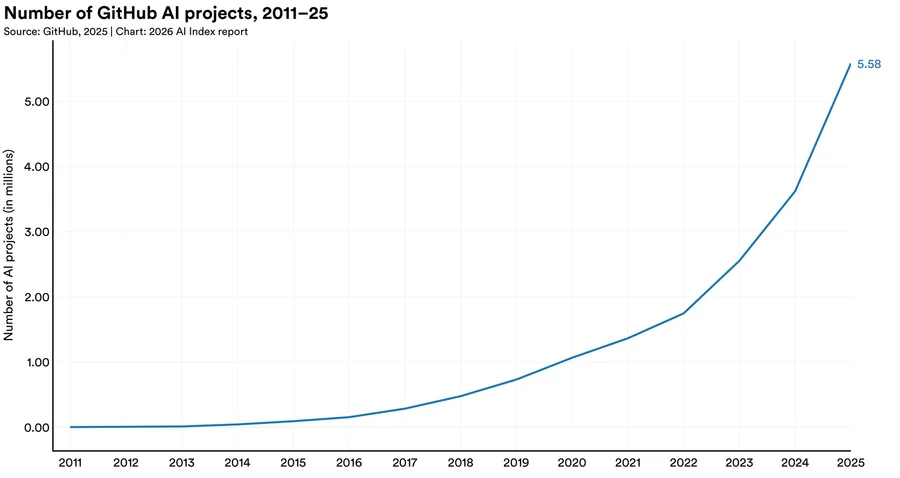

Il dato concreto per chi lavora nell'AI in Italia è un altro. I 5,58 milioni di progetti AI su GitHub nel 2025 rappresentano una crescita di cinque volte rispetto al 2020, e le pubblicazioni scientifiche sull'AI applicata alla medicina — dalla drug discovery all'imaging biomedicale multimodale — sono più che raddoppiate in due anni, passando da 1.470 a oltre 3.300. Le pubblicazioni accademiche restano al 68% del totale, contro il 12,5% dell'industria e l'11,5% del governo. Lo spazio per università, IRCCS e centri di ricerca italiani non è nella corsa ai modelli di frontiera — quella partita si è chiusa nell'ultimo triennio — ma nella ricerca applicata verticale, dove lo Stanford AI Index registra una crescita del 170% delle pubblicazioni in due anni.

Numero di progetti AI su GitHub, 2011-25, fonte GitHub, 2026

Fonti primarie consultate

- Stanford AI Index Report 2026 — Institute for Human-Centered AI, Università di Stanford (oltre 400 pagine, pubblicato 13 aprile 2026)

- Ray Perrault, co-direttore del comitato direttivo dell'AI Index — dichiarazioni rilasciate a IEEE Spectrum

- Epoch AI — stime indipendenti su numero di modelli notable e emissioni CO₂ Grok 4

- International Federation of Robotics (IFR) — dati installazioni robot industriali 2024

- Quid — dati investimenti corporate AI 2013–2025

- Ipsos — survey globale percezione e fiducia nell'AI 2022–2025 (28 paesi)

- ClockBench Leaderboard 2026 — benchmark lettura orologi analogici

- Brynjolfsson et al., 2025 — dati occupazionali per fasce d'età