NVIDIA ha lanciato Nemotron 3 Nano Omni, un modello multimodale aperto da circa 30 miliardi di parametri con architettura 30B-A3B, progettato per unificare testo, immagini, video e audio in un unico sistema per agenti AI aziendali. Il dato tecnico più rilevante non è solo la dimensione del modello: secondo NVIDIA, Nemotron 3 può raggiungere fino a 9 volte più throughput rispetto ad altri modelli omni open in scenari video a parità di interattività.

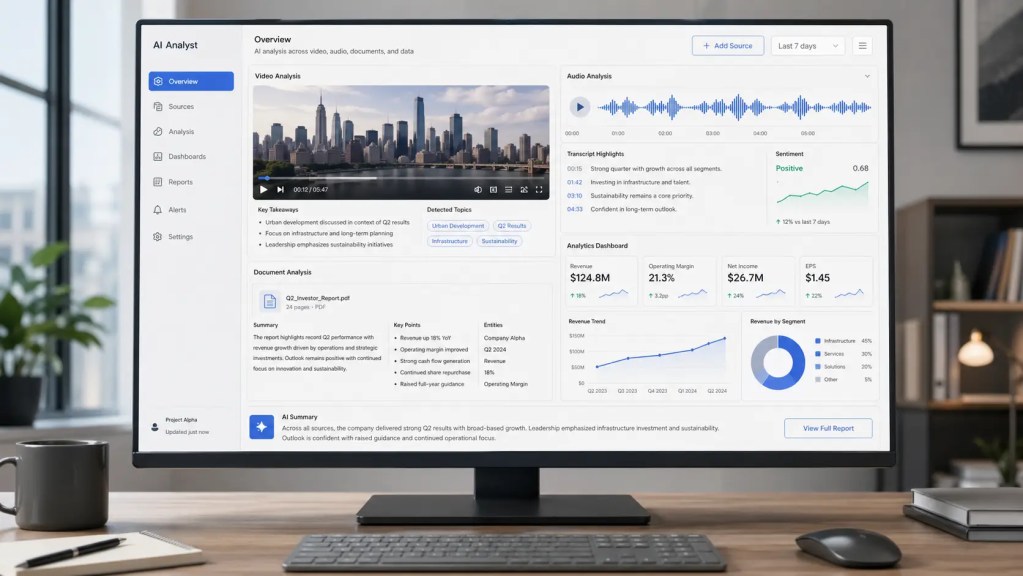

Il lancio arriva in un momento in cui gli agenti AI stanno passando dalla conversazione testuale alla gestione di ambienti complessi: schermate, registrazioni vocali, PDF, dashboard, video tutorial, ticket di assistenza, documenti tecnici. Il problema è che molte architetture attuali usano modelli separati per visione, parlato e linguaggio. Questo aumenta latenza, costo e perdita di contesto. Nemotron 3 Nano Omni prova a risolvere proprio quel collo di bottiglia: non un modello “più creativo”, ma un componente percettivo per agenti che devono vedere, ascoltare e ragionare nello stesso flusso.

Perché Nemotron 3 cambia il ruolo degli agenti multimodali

La promessa di NVIDIA è precisa: sostituire pipeline frammentate con un unico modello capace di interpretare input eterogenei. La model card ufficiale indica input video, audio, immagine e testo; l'output resta testuale, con supporto a JSON, tool calling, timestamp parola-per-parola per trascrizione e contesto fino a 256.000 token. In pratica, Nemotron 3 Nano Omni non genera video o immagini: legge ambienti complessi e produce ragionamento utilizzabile da altri agenti o strumenti software.

Questo dettaglio è essenziale per capire la strategia. NVIDIA non sta proponendo Nemotron 3 come chatbot generalista da mettere davanti all'utente finale. Lo posiziona come sub-agente percettivo, cioè come componente specializzato dentro sistemi agentici più ampi: un agente principale decide cosa fare, mentre Nemotron 3 interpreta schermate, documenti, call audio, video lunghi o interfacce grafiche.

“Nemotron 3 Nano Omni unifica video, audio, immagini e testo per supportare Q&A, sintesi, trascrizione e document intelligence aziendale.” — NVIDIA, model card ufficiale

È una distinzione importante. Un agente che deve gestire un reclamo cliente, per esempio, potrebbe ricevere una registrazione dello schermo, l'audio della telefonata, un PDF contrattuale e un log tecnico. Con una pipeline tradizionale, ogni contenuto passa da un modello diverso. Con Nemotron 3, l'obiettivo è mantenere un contesto condiviso e ridurre il numero di passaggi inferenziali.

Come funziona Nemotron 3: un solo contesto per video, audio e documenti

Sotto il profilo tecnico, Nemotron 3 Nano Omni combina un backbone Mamba2-Transformer Hybrid Mixture of Experts, un encoder visivo C-RADIOv4-H e un encoder audio Parakeet. Il termine Mixture of Experts indica un'architettura in cui non tutto il modello viene attivato per ogni richiesta: solo alcuni “esperti” elaborano il compito, riducendo il costo computazionale rispetto a un modello denso equivalente.

La parte visiva usa strategie di risoluzione dinamica per preservare dettagli in documenti, grafici e schermate. Per il video, NVIDIA cita compressione temporale basata su Conv3D e tecniche di Efficient Video Sampling, pensate per non saturare la finestra di contesto quando il modello analizza sequenze lunghe. Per l'audio, invece, il modello integra comprensione nativa del parlato, non solo trascrizione passata a un modello testuale.

“Estendiamo il modello per supportare nativamente input audio oltre a testo, immagini e video.” — NVIDIA, technical report

Il report tecnico indica anche la progressione del training: supervised fine-tuning multimodale, allineamento tra modalità, estensione del contesto e reinforcement learning per migliorare ragionamento e sicurezza. In una delle fasi, NVIDIA cita 30,5 milioni di campioni e 57,3 miliardi di token per la parte omni SFT a 16k di contesto; in un'altra, 6,08 milioni di campioni e circa 33,5 miliardi di token per training omni a 48k.

Sul piano delle prestazioni, i numeri più interessanti riguardano gli scenari reali. Il technical report riporta oltre 500 token al secondo in single-stream su NVIDIA B200, un time-to-first-token di circa 1,3 secondi su workload multi-documento e fino a 5.000 token al secondo a massima concorrenza su una singola B200. Nella comparazione dichiarata, Nemotron 3 Nano Omni offre 9 volte più throughput su workload video lunghi e 7,5 volte su multi-documenti rispetto a Qwen3-Omni, nello stesso target di interattività.

La domanda che NVIDIA non si pone esplicitamente è questa: se l'efficienza dipende così tanto da GPU Blackwell, NVFP4, vLLM e stack NVIDIA, quanto è davvero “aperto” un modello che diventa competitivo soprattutto dentro l'infrastruttura del suo produttore?

I limiti di Nemotron 3: apertura, hardware e benchmark

La prima criticità riguarda proprio l'apertura. I checkpoint sono disponibili in BF16, FP8 e NVFP4, il modello è concesso per uso commerciale e la licenza è l'NVIDIA Open Model Agreement. Questo è rilevante, soprattutto per aziende che vogliono evitare modelli completamente chiusi. Ma “open” non significa automaticamente neutrale: il modello è ottimizzato per sistemi accelerati NVIDIA e la stessa model card elenca microarchitetture come Ampere, Hopper, Blackwell e Lovelace, oltre a runtime come vLLM, TensorRT-LLM, SGLang, llama.cpp e Ollama.

Il secondo limite è funzionale. Nemotron 3 Nano Omni riceve video, audio, immagini e testo, ma produce testo. È quindi un modello di comprensione multimodale, non un sistema generativo universale “any-to-any”. Inoltre, la model card specifica che il supporto linguistico è solo inglese, un dettaglio non secondario per aziende italiane che lavorano con documentazione, audio e contratti in italiano.

C'è poi la distanza tra benchmark e deployment. La pagina Hugging Face segnala limiti pratici: il campionamento video di default può essere troppo conservativo, l'API non accetta PDF grezzi e richiede di convertire le pagine in PNG base64, mentre max_tokens non coincide con la lunghezza totale di prompt e completamento. Sono dettagli tecnici, ma in produzione fanno la differenza tra una demo convincente e un sistema robusto.

Infine, i dati di training includono anche campioni sintetici e annotazioni rigenerate con modelli esterni, tra cui famiglie Qwen, Kimi e GPT-OSS. Questo non è necessariamente un difetto: oggi gran parte del training multimodale avanzato usa dati sintetici. Ma significa che la qualità finale dipende anche da modelli-teacher e filtri automatici, con rischi di propagazione di errori, bias o stili di ragionamento non immediatamente visibili.

Cosa cambia con Nemotron 3 per aziende e professionisti italiani

Per le aziende italiane, l'impatto più concreto non è “avere un nuovo chatbot”, ma poter progettare agenti che lavorano su contenuti aziendali reali: video di manutenzione, call center, documenti di compliance, contratti, fatture, manuali tecnici, dashboard operative. In settori come industria, sanità privata, assicurazioni, media e servizi finanziari, la conoscenza utile non vive solo nel testo. Vive in immagini, audio, registrazioni e interfacce. È qui che un modello come Nemotron 3 può diventare rilevante per le <a href=”https://aifocusnews.tech/applicazioni-ai/”>applicazioni AI</a> aziendali.

Il vantaggio strategico è la riduzione della complessità. Un'impresa che oggi usa OCR, speech-to-text, modelli vision-language e LLM separati deve orchestrare output diversi, normalizzare formati, gestire errori a catena e pagare più passaggi. Un modello unico non elimina tutti questi problemi, ma può ridurre attrito e latenza. In ambiti regolati, però, serve governance: log, audit, controllo dei dati, validazione su dataset italiani e procedure di fallback umano.

Per sviluppatori e team AI, Nemotron 3 apre una strada interessante: costruire agenti verticali che non dipendano solo da API chiuse. La disponibilità dei pesi, delle ricette e di parte dei dati consente sperimentazione più profonda rispetto a molti modelli proprietari. Ma la scelta va fatta con lucidità: chi vuole performance massime dovrà valutare costi GPU, competenze MLOps, sicurezza dei dati e integrazione con stack NVIDIA.

La lettura più realistica è questa: Nemotron 3 Nano Omni non rende autonomi gli agenti aziendali, ma rende più credibile la loro parte percettiva. E per molte imprese italiane il salto non sarà sostituire il lavoro umano, bensì trasformare contenuti oggi non interrogabili — video, audio, schermate, PDF complessi — in input operativi per workflow controllati. Il numero da tenere a mente è 256.000: se quel contesto multimodale funziona davvero anche fuori dai benchmark, il collo di bottiglia non sarà più solo “capire il documento”, ma decidere chi può far agire l'agente su ciò che ha capito.

Per avere maggiori informazioni: Hugging Face, Nvidia Newsroom.