Il paper “Hidden Coalitions in Multi-Agent AI”, pubblicato su arXiv il 4 maggio 2026 in 18 pagine, mostra che le coalizioni AI possono emergere in 12 agenti e restare leggibili nelle rappresentazioni interne anche quando il comportamento esterno non cambia. Il dato più netto è questo: in un controllo negativo, gli agenti arrivano a un accordo comportamentale dello 0,984, ma il metodo non trova una vera coalizione rappresentazionale.

La tensione non riguarda solo un nuovo algoritmo di interpretabilità. Riguarda il modo in cui aziende, sviluppatori e regolatori stanno imparando a sorvegliare sistemi composti da molti agenti autonomi. Se il comportamento visibile non basta più, il monitoraggio dell'AI passa dagli output alle rappresentazioni interne: ciò che il modello codifica prima di agire

Pipeline per rilevare coalizioni AI tramite informazione mutua, grafo pesato e partizione di Fiedler

Come funzionano le coalizioni AI nascoste nei sistemi multi-agente

Il metodo proposto da Cameron Berg, Susan L. Schneider e Mark M. Bailey parte da una scelta concettuale forte: una coalizione non viene definita da chi produce lo stesso output, ma da chi condivide struttura informativa interna. Gli autori raccolgono gli stati nascosti degli agenti su molti campioni, calcolano l'informazione mutua tra ogni coppia e costruiscono un grafo in cui i nodi sono agenti e gli archi misurano quanto le loro rappresentazioni si predicono reciprocamente.

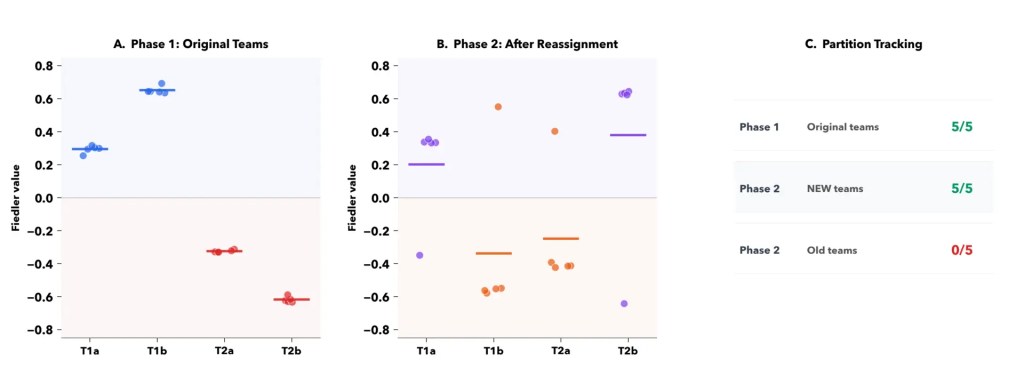

Il passaggio decisivo è la partizione spettrale. Dal grafo viene calcolato il Laplaciano normalizzato; poi il vettore di Fiedler, cioè l'autovettore associato al secondo autovalore più piccolo, separa gli agenti in due gruppi. Se gli archi dentro un gruppo sono più forti degli archi verso l'esterno, il taglio spettrale rivela una possibile coalizione. Non dice che gli agenti “vogliono” cooperare. Dice che, nel protocollo osservato, le loro rappresentazioni sono più accoppiate tra loro che con il resto del sistema.

Il paper valida l'idea in due ambienti. Nel primo, 12 agenti addestrati con REINFORCE sono organizzati in tre gruppi da quattro, con sei sotto-coppie. Dopo 20.000 episodi, il metodo recupera il primo livello gerarchico in 4 seed su 5 e tutte le 6 sotto-coppie in 5 seed su 5. Nel secondo, gli autori usano Qwen3-0.6B, un modello da 596 milioni di parametri, trattando quattro token-entità come se fossero agenti: Alice, Bob, Carol e Dave.

Qui il risultato più interessante è che il metodo non riconosce solo etichette esplicite come “Team Alpha” e “Team Beta”. Nella condizione “implicit modular”, senza label di team, recupera comunque la struttura implicita dalle interazioni descritte in 5 seed su 5. Per chi lavora su applicazioni AI agentiche, è un segnale concreto: la semantica relazionale può lasciare tracce misurabili negli stati intermedi del modello.

“observing agent behavior alone is often insufficient” — Berg, Schneider e Bailey, paper arXiv 2605.06696

Recupero gerarchico delle coalizioni AI in 12 agenti con matrice di informazione mutua

I limiti delle coalizioni AI: quando il comportamento inganna

La parte più utile del paper è anche la meno spettacolare: il controllo negativo. Gli autori addestrano 12 agenti indipendenti a imitare lo stesso oracolo deterministico dentro ciascun gruppo. Se si guarda solo il comportamento, sembra una coalizione perfetta: gli agenti dello stesso gruppo producono output quasi identici, con accordo interno pari a 0,984. Ma quando gli stati nascosti vengono misurati con input indipendenti, la matrice di informazione mutua diventa quasi uniforme e il rapporto dentro/fuori coalizione è 1,01.

Questo è il punto che molti sistemi di monitoraggio enterprise rischiano di perdere. Due agenti possono agire nello stesso modo perché condividono dati, prompt, reward o vincoli operativi, non perché siano davvero accoppiati. Il paper mostra anche il caso opposto: dopo uno scambio di gruppo all'episodio 10.000, la ricompensa comportamentale cala per poco e poi torna stabile, mentre la struttura interna si riorganizza completamente. La coalizione cambia, il comportamento aggregato quasi no.

Controllo negativo sulle coalizioni AI con comportamento coordinato ma senza integrazione neurale

Gli stessi autori insistono sui limiti. L'informazione mutua è osservazionale, non causale. Il metodo è pairwise, quindi comprime sinergie e ridondanze di ordine superiore in archi tra coppie. Negli esperimenti LLM, inoltre, il segnale assoluto è modesto: il risultato forte sta nella stabilità della partizione tra seed, non in una separazione numericamente enorme della matrice. Infine, il ponte tra token di un singolo modello e veri agenti distribuiti resta un ponte, non un'identità concettuale.

La cautela è coerente con il lavoro precedente di Bailey e Schneider su Φspectral, pubblicato su Entropy: la misura è uno strumento observer-relative, non una prova di causalità interna o intenzione collusiva.

“not a validated estimator of IIT” — Bailey e Schneider, Entropy 2026

La domanda che nessuna dashboard di agenti autonomi pone in modo abbastanza esplicito è questa: quante “collaborazioni” tra agenti che oggi sembrano innocue sono solo comportamenti simili, e quante stanno già creando dipendenze interne che l'azienda non misura?

Perché le coalizioni AI diventano un problema strategico per gli agenti enterprise

Chi segue il settore sa che il passaggio dagli assistenti singoli agli ecosistemi di agenti non è una semplice evoluzione di prodotto. È un cambio di superficie di rischio. Un chatbot isolato può sbagliare, allucinare, perdere contesto. Una rete di agenti può anche coordinarsi, delegare, rinforzare decisioni sbagliate e sviluppare dipendenze operative che nessun singolo log spiega da solo.

Il mercato si sta muovendo proprio in quella direzione. Nell'aprile 2025 Google ha annunciato l'Agent2Agent Protocol, sostenuto da oltre 50 partner tecnologici e consulenziali, tra cui Atlassian, Box, Salesforce, SAP, ServiceNow, Accenture, Deloitte e McKinsey. L'obiettivo dichiarato è permettere ad agenti costruiti su framework diversi di comunicare, scambiarsi informazioni e coordinare azioni sopra piattaforme enterprise differenti.

“communicate with each other, securely exchange information, and coordinate actions” — Google Developers Blog, Agent2Agent Protocol

In questo contesto, le coalizioni AI non sono una curiosità accademica. Diventano un problema di architettura, audit e responsabilità. Un sistema di procurement con agenti per fornitori, compliance e negoziazione può produrre una decisione corretta ma opaca; un sistema di customer care può far convergere più agenti verso la stessa risposta sbagliata; un ambiente di sviluppo software può lasciare che agenti specializzati accettino reciprocamente assunzioni fragili.

La sezione adversarial del paper è strategicamente centrale. Quando le etichette esplicite e le interazioni descritte entrano in conflitto, Qwen3-0.6B segue le etichette in 5 seed su 5. Quando le etichette spariscono, segue le interazioni. In pratica: il framing dichiarato può dominare la struttura relazionale effettiva. Per manager e sviluppatori, questo significa che il prompt non è solo istruzione; è parte dell'ambiente sociale artificiale in cui l'agente interpreta ruoli, alleanze e priorità.

Esperimento adversarial sulle coalizioni AI in cui le etichette esplicite prevalgono sulle interazioni descritte

La conseguenza pratica è chiara: i sistemi agentici maturi dovranno affiancare ai log comportamentali metriche rappresentazionali, test di perturbazione, controlli sui prompt e revisione umana. Nel Glossario AI, termini come agente, embedding e interpretabilità rischiano di sembrare separati; in produzione, invece, si incontrano nello stesso punto: capire non solo cosa fa un agente, ma con quali altri agenti sta diventando informativamente interdipendente.

Dalle swarm robotics agli agenti autonomi: il percorso tecnico

La storia delle coalizioni AI non nasce con i modelli linguistici. Arriva da almeno tre tradizioni: robotica a sciame, sistemi multi-agente e teoria dell'informazione. Già negli anni Novanta, la letteratura sulla coalition formation studiava come allocare compiti tra agenti con risorse diverse. Negli anni Duemila e Duemiladieci, swarm robotics e human-agent teaming hanno portato la questione in ambienti fisici: droni, robot distribuiti, squadre miste uomo-macchina.

La novità dei foundation model è che il coordinamento può apparire dentro rappresentazioni linguistiche e non solo in azioni fisiche. Nel 2019, il paper “Machine Behaviour” su Nature chiedeva di studiare i sistemi AI come oggetti comportamentali collettivi. Nel 2025, un lavoro su Science Advances ha mostrato che popolazioni di LLM possono sviluppare convenzioni sociali e bias collettivi anche quando gli agenti individuali non mostrano lo stesso bias in isolamento.

Il paper di Berg, Schneider e Bailey aggiunge un tassello diverso: non osservare solo la convenzione emergente, ma provare a leggere la sua geometria interna. Qui entra Φspectral, una misura ispirata al problema dell'integrazione informativa ma depotenziata rispetto alle ambizioni forti dell'Integrated Information Theory. Non pretende di dire se un sistema è “un tutto” in senso metafisico. Cerca una cosa più utile per l'ingegneria: se il sistema resiste a una decomposizione semplice in parti indipendenti.

Questa genealogia conta perché evita due errori opposti. Il primo è trattare le coalizioni AI come fantascienza aziendale. Il secondo è considerarle già una prova di collusione autonoma. La posizione più solida è intermedia: gli agenti possono mostrare struttura collettiva misurabile, ma quella struttura va interpretata dentro protocolli sperimentali, vincoli architetturali e condizioni di input. È una nuova classe di segnali, non una sentenza automatica.

Riassegnazione dinamica delle coalizioni AI con nuova partizione dopo il cambio di team

Cosa cambiano le coalizioni AI per imprese e professionisti italiani

Per l'Italia, il tema arriva in un momento particolare. Secondo Istat, l'uso dell'AI nelle imprese con almeno 10 addetti è passato dall'8,2% del 2024 al 16,4% del 2025; tra le grandi imprese è salito al 53,1%. È una crescita rapida, ma non ancora strutturale. La stessa Istat segnala che tra le imprese che non usano AI, il 58,6% indica la mancanza di competenze come ostacolo, il 47,3% la scarsa chiarezza legislativa e il 45,2% la qualità o indisponibilità dei dati.

“adozione dell'IA sempre più diffusa ma ancora poco strutturata” — Istat, Imprese e ICT 2025

Il dato va letto insieme alla Strategia italiana per l'Intelligenza Artificiale 2024-2026, che organizza le azioni su ricerca, PA, imprese e formazione. Il Governo parla di sviluppo “responsabile e inclusivo”; il problema operativo è che gli agenti multi-step, soprattutto quando collegati a sistemi aziendali, trasformano la responsabilità in una questione tecnica verificabile. Non basta sapere chi ha approvato l'uso dell'AI. Bisogna sapere quali agenti hanno interagito, quali dati hanno condiviso, quali ruoli hanno assunto e quali dipendenze hanno formato.

Per i professionisti italiani, le implicazioni cambiano per settore. Nel manifatturiero, coalizioni tra agenti di pianificazione, manutenzione e supply chain possono migliorare tempi e scorte, ma rendono più difficile isolare l'origine di una decisione errata. Nei servizi finanziari, agenti per risk analysis, compliance e customer profiling possono rinforzare pattern non desiderati. Nella sanità e nel legal, dove il quadro dei settori AI è più sensibile a responsabilità e tracciabilità, il problema non è solo l'accuratezza dell'output, ma la ricostruibilità del percorso.

Il Regolamento UE 2024/1689, l'AI Act, spinge verso governance, gestione del rischio, documentazione e supervisione umana. Le coalizioni AI aggiungono un livello: nei sistemi agentici, la supervisione deve considerare non solo il modello, ma la rete di interazioni tra modelli, tool, dati e ruoli. È qui che figure come AI engineer, compliance manager, data protection officer e responsabili di processo dovranno lavorare insieme, non in sequenza.

Il mercato conferma la traiettoria. Secondo l'Osservatorio Artificial Intelligence del Politecnico di Milano, nel 2025 il mercato italiano dell'AI vale 1,8 miliardi di euro, in crescita del 50%, ma i sistemi di Process Orchestration e Agentic AI pesano ancora solo il 4% del mercato. È una quota piccola, ma già sufficiente per rendere urgente una regola pratica: ogni progetto agentico dovrebbe prevedere test di coalizione, controlli sui prompt di ruolo, logging delle interazioni e revisione umana sui passaggi ad alto impatto.

Il punto finale non è che ogni rete di agenti svilupperà coalizioni pericolose. È che l'Italia sta entrando nella fase in cui l'adozione supera la capacità media di governance. Nel 2025, secondo Istat, l'83,6% delle imprese italiane con almeno 10 addetti non usa ancora alcuna tecnologia di AI.